Einführung

Die Landschaft der Softwarearchitektur befindet sich in einem tiefgreifenden Wandel. Jahrzehntelang wurde die Grundlage jeder robusten Anwendung – die Datenbank – durch gründliche, manuelle Arbeit entworfen. Dieser Prozess, bekannt als dieEntwicklung der Datenbankmodellierung, befindet sich nun in der Transition von der Ära der manuellen Baupläne zu einer neuen Ära derKI-getriebenen Architektur.

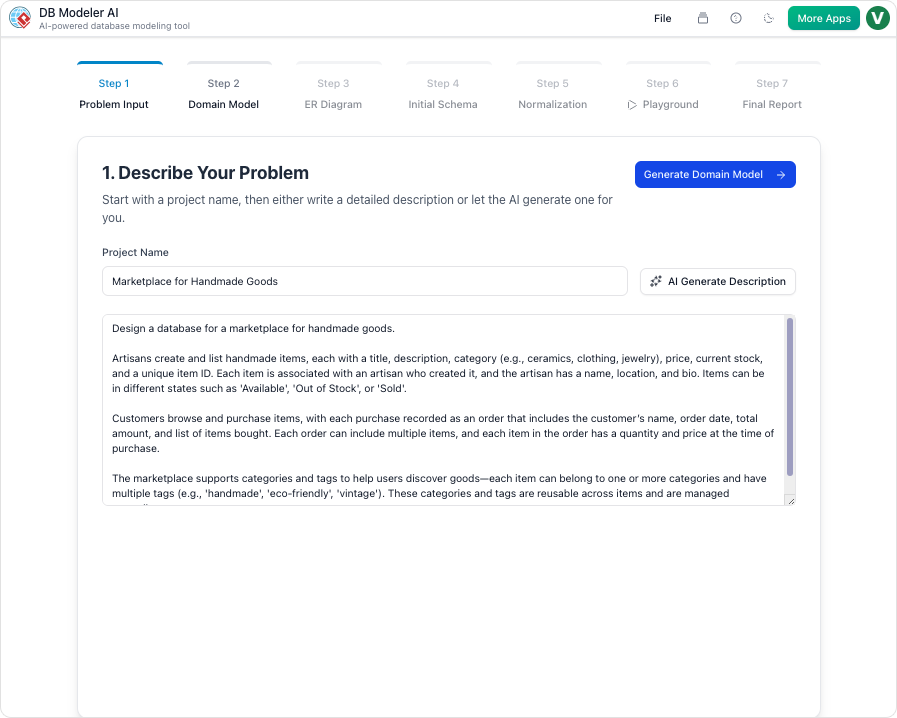

Traditionell erforderte die Gestaltung von Datenstrukturen tiefgreifendes Fachwissen, isolierte Tools und erhebliche Zeitaufwendungen. Es war ein hochfriction-orientierter Prozess, der anfällig für menschliche Fehler, Redundanzen und Architekturverschuldung war. Doch Innovationen wieVisual Paradigm’s DB Modeler KI haben diesen Status quo gestört. Durch die Einführung eines intelligenten, geführten7-Schritte-Workflow, nutzt diese Technologie generative KI, um einfache englische Beschreibungen in vollständig normalisierte, produktionsfertige Datenbank-Schemata zu transformieren.

Dieser umfassende Leitfaden untersucht diese Entwicklung und hebt die deutlichen Unterschiede zwischen herkömmlichen Methoden und modernen KI-Fähigkeiten hervor. Wir werden die praktische Anwendung dieser Tools anhand eines klassischenOnline-BuchhandlungSzenario durchgehen, um zu zeigen, wie KI traditionelle Probleme beseitigt und die professionelle Datenbankgestaltung beschleunigt.

Die traditionelle Herausforderung: Manuelle Beschränkungen und hohe Reibung

In der Vor-KI-Ära wurde die Datenbankmodellierung als eine arbeitsintensive Kunst angesehen, die nur Spezialisten vorbehalten war. Der Prozess war voller Herausforderungen, die oft die Entwicklungszyklen verlangsamten und Schwachstellen einführten.

Der klassische Workflow

- Die leere Leinwand:Designer begannen mit leeren Arbeitsflächen in Tools wie ER/Studio, Lucidchart oder sogar physischen Stift-und-Papier-Blättern. Es gab keine Ausgangsposition; jedes Objekt musste von Grund auf neu entworfen werden.

- Manuelle Identifikation: Der Architekt musste manuell identifizierenEntitäten, Attribute, Beziehungen, Primärschlüssel (PKs), undFremdschlüssel (FKs). Dies erforderte ein perfektes mentales Modell der Geschäftslogik, bevor überhaupt eine einzige Linie gezeichnet wurde.

- Das Normalisierungsproblem: Der Übergang von einem rohen Entwurf zu einem bereitgestellten Schema beinhaltet Normalisierung (1NF → 2NF → 3NF). Dieser Prozess sucht nach Redundanzen, partiellen Abhängigkeiten und transitiven Abhängigkeiten. Traditionell erforderte dies mühsame manuelle Analyse, die äußerst anfällig für Übersehen und menschliche Fehler war.

- Passive Werkzeuge: Legacy-Werkzeuge fungierten als digitale Zeichenbretter. Sie boten keine intelligenten Vorschläge, keine automatischen Übergänge zwischen konzeptuellen und logischen Modellen und keine Überprüfung über die grundlegende Syntaxprüfung hinaus.

- Test-Silos: Die Validierung erforderte die Einrichtung lokaler Datenbankumgebungen (z. B. PostgreSQL, MySQL), das manuelle Schreiben von

INSERTSkripten und die Hoffnung, dass Abfragen Integritätsprobleme aufdecken würden.

Das Ergebnis dieses manuellen Ansatzes war oft erhebliche architektonische Schulden, lange Iterationszyklen und eine steile Lernkurve, die Nichtexperten wie Produktmanager oder Studierende von dem Gestaltungsprozess ausschloss.

Der paradigmatische Wandel durch KI

DB Modeler AI, überVisual Paradigms Online-Plattform, stellt eine grundlegende Veränderung dar, wie wir mit Daten umgehen. Es fungiert nicht nur als Werkzeug, sondern als „intelligenter Co-Pilot“. Unter Verwendung von Natürliche Sprachverarbeitung (NLP) und umfassendem Fachwissen interpretiert es Geschäftsanforderungen, um standardskonforme Modelle zu generieren.

Vergleich: Traditioneller vs. KI-getriebener Modellierung

Die folgende Tabelle zeigt die wesentlichen operativen Unterschiede zwischen dem traditionellen manuellen Ansatz und dem modernen KI-getriebenen Workflow.

| Funktion | Traditioneller manueller Ansatz | KI-getriebener Ansatz (DB Modeler AI) |

|---|---|---|

| Eingabemechanismus | Manuelles Ziehen und Ablegen; explizite Definition jeder Spalte. | Natürliche Sprache (einfache englische Beschreibungen). |

| Geschwindigkeit | Tage oder Wochen für komplexe Schemata. | Minuten von der Konzeption bis zur normalisierten Schema. |

| Normalisierung | Manuelle Analyse; anfällig für menschliche Fehler und Übersehen. | Automatisierte, schrittweise Anleitung (1NF, 2NF, 3NF) mit Erklärungen. |

| Validierung | Erfordert externe DB-Setup und manuelles Skriptgeschrieb. | Sofortiger, im Browser verfügbares SQL-Playground mit künstlich generierten Testdaten. |

| Zugänglichkeit | Erfordert tiefgehendes Wissen in SQL/Architektur. | Erreichbar für Entwickler, Produktmanager, Studierende und Architekten. |

| Ausgabeanlage | Komplett abhängig von der Expertise des Benutzers. | Standardisierte, best-practice-konforme, produktionsfertige DDL. |

Der 7-Schritte-geführt Workflow

Visual ParadigmDie DB Modeler AI von ‚s nutzt einen transparenten, siebenstufigen Prozess, der den Benutzer von einer vagen Idee zu einem konkreten, getesteten Datenbankschema führt.

1. Problem-Eingabe

Der Prozess beginnt mit einem einfachen Prompt. Benutzer beschreiben ihre Anwendung in einfacher Sprache. Zum Beispiel: „Erstellen Sie eine Datenbank für einen Online-Buchhandel, die Bücher, Autoren, Kunden, Bestellungen verwaltet und die Verfolgung von Sendungen ermöglicht.“ Die KI analysiert diesen Text, um die Kernanforderungen zu extrahieren.

2. Domänen-Klassen-Diagramm

Bevor in Tabellen und Schlüssel eingegangen wird, generiert die KI eine hochgradige konzeptionelle Ansicht mit PlantUML-Syntax. Dies hilft, die Objekte und ihre Beziehungen abstrakt darzustellen und sicherzustellen, dass der Umfang vor der technischen Umsetzung korrekt ist.

3. ER-Diagramm-Generierung

Das System wechselt automatisch vom konzeptionellen Modell zum detaillierten logischen Entität-Beziehung-Diagramm (ERD). Es definiert Tabellen, Spalten, Kardinalitäten, Primärschlüssel und Fremdschlüssel automatisch.

4. Generierung des Ausgangsschemas

Das ERD wird in SQL-Data Definition Language (DDL) umgewandelt. Das Werkzeug verwendet typischerweise weit verbreitete Standards wie PostgreSQL, um Kompatibilität mit modernen Technologie-Stacks sicherzustellen.

5. Intelligente Normalisierung

Dies ist mit Sicherheit der kritischste Schritt. Die KI verfeinert das Schema schrittweise, um die Datenintegrität sicherzustellen:

- 1NF (Erste Normalform): Stellt Atomarität sicher. Es beseitigt mehrwertige Felder (z. B. sicherstellt, dass eine Zelle keine durch Kommas getrennte Liste von Autoren enthält).

- 2NF (Zweite Normalform): Beseitigt partielle Abhängigkeiten. Es stellt sicher, dass nicht-schlüsselbasierte Attribute vollständig vom Primärschlüssel abhängen, oft durch Aufteilung von Tabellen (z. B. Trennung der Autordaten von der Buchtabelle).

- 3NF (Dritte Normalform): Beseitigt transitive Abhängigkeiten. Es stellt sicher, dass Spalten nur vom Primärschlüssel abhängen, nicht von anderen nicht-schlüsselbasierten Spalten.

Wesentlich ist, dass die KI pädagogische Begründungenfür jede Entscheidung bereitstellt, wobei erklärt wird, warumeine Tabelle aufgeteilt wurde, was sie zu einem leistungsfähigen Lernwerkzeug macht.

6. Interaktive Spielwiese

Anstatt einen lokalen Server zu erfordern, bietet das Tool eine browserbasierte SQL-Umgebung. Es füllt das Schema automatisch mit realistischen, künstlich generierten Beispiel-Daten auf. Dies ermöglicht die sofortige Prüfung von Abfragen und CRUD-Operationen.

7. Endbericht & Export

Nach der Validierung kann der Benutzer einen Markdown-Entwurfsbericht generieren, die SQL-Skripte exportieren und Diagramme im PDF- oder JSON-Format herunterladen. Dies dient als „einziges Quellwerk“ für das Entwicklungsteam.

Praktisches Beispiel: Gestaltung eines Online-Buchhandels

Um die Stärke dieses Workflows zu zeigen, wenden wir ihn auf das Online-BuchhandelSzenario an, das im Quellmaterial erwähnt wird.

Schritt 1: Die Anfrage

Wir geben die folgende Anforderung ein: „Ich benötige ein System für einen Online-Buchhandel, um Bücher (mit Titeln, Autoren, Preisen, Kategorien, ISBN), Kunden (Name, E-Mail, Adresse), Bestellungen (Datum, Status, Gesamtsumme) und Bestellpositionen zu verwalten. Kunden durchsuchen nach Autor/Kategorie, stellen Bestellungen auf und verfolgen die Lieferungen.“

Schritt 2 & 3: Visualisierung der Struktur

Die KI erstellt sofort ein DomänenKlassendiagramm gefolgt von einem ER-Diagramm. Es erkennt, dass ein Kunde hat eine 1:N Beziehung zu Bestellungen, und dass Bücher haben eine N:M (Viele-zu-Viele) Beziehung zu Bestellungen, was eine Zwischentabelle erfordert Bestellposition Tabelle.

Schritt 4 & 5: Verfeinerung und Normalisierung

Anfangs könnte das Schema den Namen des Autors direkt in der Bücher Tabelle speichern. Die KI erkennt dies als Verstoß gegen die optimale Datenbankgestaltung.

- Aktion: Die KI extrahiert

Autorin eine eigene Tabelle. - Ergebnis: Die

BücherTabelle enthält nun eineauthor_idFremdschlüssel. - Vorteil: Dies beseitigt Redundanz; wenn ein Autor seinen Namen ändert, muss dies nur an einer Stelle aktualisiert werden.

Schritt 6: Testen im Playground

Mit dem generierten Schema füllt die KI die Datenbank mit realistischen Daten (z. B. „Der große Gatsby“ von F. Scott Fitzgerald). Wir können sofort eine Testabfrage ausführen, um die Struktur zu überprüfen:

SELECT b.title, a.name

FROM books b

JOIN authors a ON b.author_id = a.id

WHERE b.category = 'Fiction';Wenn die Abfrage die erwarteten Ergebnisse liefert, wird die Gestaltung sofort validiert.

Fazit: Reduzierung der architektonischen Schulden

Der Übergang von manuellen Bauplänen zu KI-getriebene Architektur über Tools wieVisual Paradigm DB Modeler KIdemokratisiert die hochwertige Datenbankgestaltung. Sie schließt die Lücke zwischen konzeptionellen geschäftlichen Anforderungen und technischer Umsetzung.

Was einst Wochen an Expertenarbeit erforderte und das Risiko kostspieliger Fehler mit sich brachte, kann nun in Minuten erledigt werden. Mit integrierten Bildungs-, Validierungs- und Kollaborationsfunktionen befähigt diese Technologie Studierende, Produktmanager und Entwickler, schneller und zuverlässigere Datenarchitekturen zu erstellen. Wenn wir uns weiterentwickeln, wird die Integration von KI in die grundlegende Phase der Datenbankmodellierung vermutlich zum Standard für die Reduzierung architektonischer Schulden und die Beschleunigung der Innovation.